産業医や人事担当者の業務において、面談記録の要約や健康情報のデータ整理など、生成AI(ChatGPTなど)を活用することで大幅な業務効率化が期待されています。

便利だからと無防備に無料のAIツールを利用すると、従業員のプライバシー侵害や企業の重大なコンプライアンス違反につながる恐れがあります。

本記事では、産業保健業務で生成AIを利用する際に絶対に知っておくべき「学習利用の制御(オプトアウト)」の基礎知識から、エビデンス・ガイドラインに基づく具体的なセキュリティ対策までを詳しく解説します。

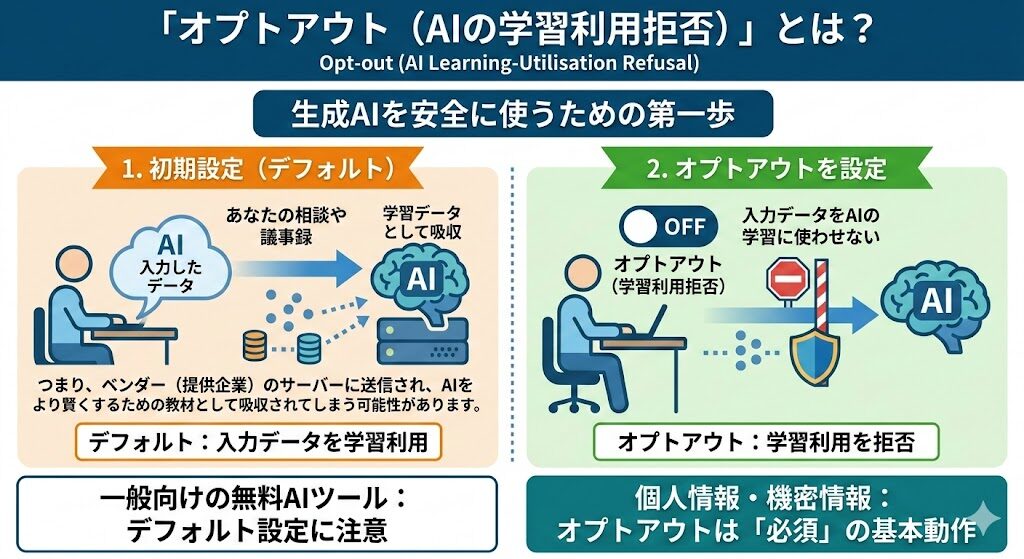

基礎知識:「オプトアウト(AIの学習利用拒否)」とは何か?

生成AIを安全に業務利用するための第一歩は、「自分が入力したデータがその後どのように扱われるか」を正しく理解することです。

デフォルト設定に潜む「学習データとしての二次利用」

ChatGPTをはじめとする多くの生成AIサービスは、デフォルト(初期設定)の状態で入力されたテキストデータを、AIモデル自身の性能向上や次世代モデルの開発のための「学習データ」として利用する規約になっています。

学習利用を防ぐ「オプトアウト」

このように、入力データをAIの学習に使わせないように拒否する設定や手続きのことを「オプトアウト(Opt-out)」と呼びます。

一般向けの無料AIツールを使用する場合、ユーザー側で意図的にこのオプトアウトの設定を行わない限り、入力したデータは学習に利用される前提となっていることが大半です。

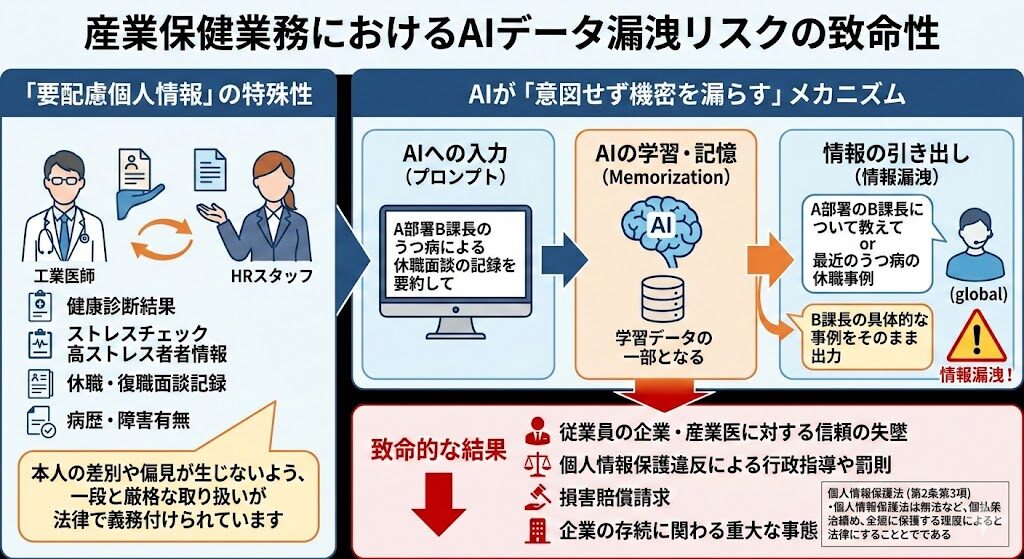

産業保健業務におけるデータ漏洩リスクの致命性

産業医や人事担当者が日常的に扱うデータは、一般的なビジネスデータとは根本的に性質が異なります。これらの情報がAIの学習データとして取り込まれてしまうリスクについて見ていきましょう。

「要配慮個人情報」の特殊性

従業員の健康診断結果、ストレスチェックの高ストレス者情報、メンタルヘルス不調による休職・復職の面談記録、病歴や障害の有無などは、個人情報保護法において「要配慮個人情報(第2条第3項)」に指定されています。

要配慮個人情報は、本人の不当な差別や偏見が生じないよう、通常の個人情報よりも一段と厳格な取り扱いが法律で義務付けられています。本人の事前の同意なく取得したり、第三者へ提供したりすることは原則として禁じられています。

AIが「意図せず機密を漏らす」メカニズム

もし、オプトアウト設定をしていないAIに「A部署のB課長のうつ病による休職面談の記録を要約して」と入力した場合、どうなるでしょうか。

そのプロンプト(入力文)はAIの学習データの一部となります。その後、世界のどこかのユーザーが「A部署のB課長について教えて」「最近のうつ病の休職事例の文章を作成して」などと類似の文脈で質問した際、AIが学習した記憶を引き出し、B課長の事例をそのまま出力してしまう(情報漏洩)リスクがゼロではありません。

これを「記憶の引き出し(Memorization)」の問題と呼びます。

産業保健における情報漏洩は、従業員の企業や産業医に対する信頼を完全に失墜させるだけでなく、個人情報保護法違反による行政指導や罰則、損害賠償請求といった企業の存続に関わる重大な事態を招きます。

ガイドラインから読み解く、企業に求められるAIセキュリティ要件

こうしたリスクに対し、政府や関連省庁も明確なガイドラインを示し、企業に慎重な対応を求めています。自社のルールを策定する上で、以下のガイドラインの主旨を理解しておくことが重要です。

総務省・経済産業省「AI事業者ガイドライン(第1.0版)」

2024年4月に公表された本ガイドラインでは、AIを利用する企業(AI利用者)に対し、以下の点を強く求めています。

- 入力データの取り扱い確認: AIサービスにデータを入力する前に、そのデータが学習に利用されるかどうか、利用規約を必ず確認すること。

- プライバシーの保護: 個人情報や機密情報を入力する場合、情報漏洩を防ぐための適切な措置(オプトアウトの利用や、学習されないサービスの選定)を講じること。

厚生労働省「医療・介護関係事業者における個人情報の適切な取扱いのためのガイダンス」

医療情報や健康情報を扱う事業者向けに厚生労働省と個人情報保護委員会が策定しているガイダンスにおいても、データの外部保存や委託を行う際には、十分なセキュリティ水準を満たす事業者の選定と、契約等による適切な安全管理措置の担保が求められています。

生成AIへのデータ入力も「外部サーバーへのデータ送信」に該当するため、利用規約上、機密保持が担保されない(学習利用されてしまう)サービスの利用は、これらのガイドラインの主旨に反する行為とみなされる可能性が高いと言えます。

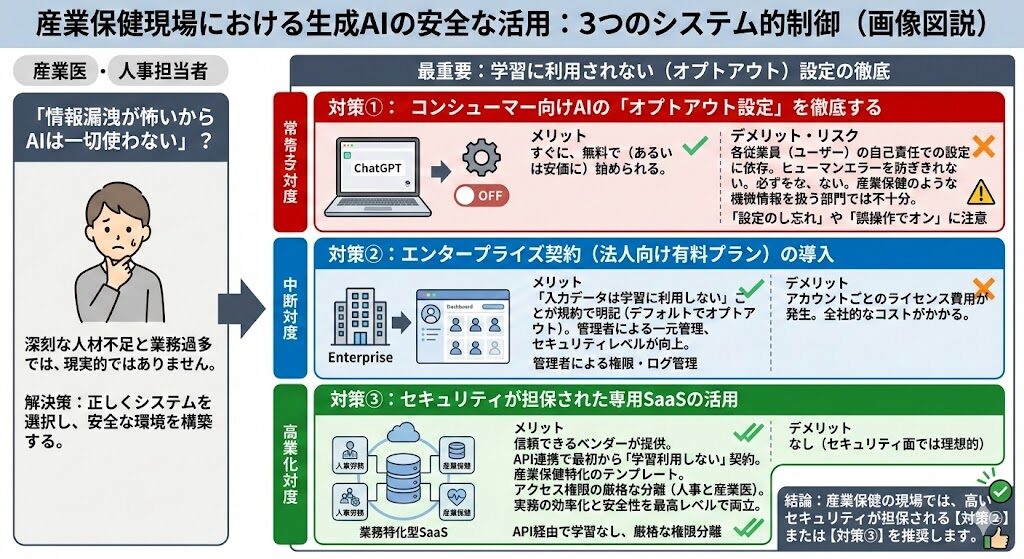

安全にAIを活用するための3つの具体策(システム的な制御)

「情報漏洩が怖いからAIは一切使わない」というのは、深刻な人材不足と業務過多に悩む産業保健の現場において現実的ではありません。

産業医や人事担当者がAIを利用する際は、必ず「学習に利用されない(オプトアウト)設定」になっているか、あるいはエンタープライズ契約や専用のSaaSを利用して、セキュリティ要件を担保してください。

具体的には、以下の3つのアプローチがあります。

対策①:コンシューマー向けAIの「オプトアウト設定」を徹底する

無料版や個人向けの有料版ChatGPTなどを業務で利用する場合、設定画面から「データコントロール(Data Controls)」や「チャット履歴とトレーニング(Chat History & Training)」の項目をオフにする必要があります。

- メリット: すぐに、無料で(あるいは安価に)始められる。

- デメリット・リスク: 各従業員(ユーザー)の自己責任での設定に依存するため、「設定のし忘れ」や「誤操作でオンに戻してしまう」というヒューマンエラーを防ぎきれません。産業保健のような機微情報を扱う部門の全社的な対策としては、不十分かつリスクが高いと言わざるを得ません。

対策②:エンタープライズ契約(法人向け有料プラン)の導入

「ChatGPT Enterprise」や「Microsoft Copilot for Microsoft 365」など、企業向けのエンタープライズプランを契約する方法です。

- メリット: 法人向けプランの大半は、「入力データはAIの学習に利用しない」ことが利用規約で明記(デフォルトでオプトアウト)されています。また、企業側のシステム管理者がユーザーのアクセス権限やログを一元管理できるため、セキュリティレベルが飛躍的に向上します。

- デメリット: アカウントごとのライセンス費用が発生し、全社的な導入には相応のコストがかかります。

対策③:セキュリティが担保された専用SaaSの活用

生成AIの機能を内部に組み込んだ、業務特化型のSaaS(インターネットを通じて利用するソフトウェア)を導入する方法です。近年、人事労務や産業保健に特化したAIツールが登場しています。

- メリット: 信頼できるベンダーが提供する法人向けSaaSであれば、API(システム間連携)経由でAIを利用するため、ベンダー側で「学習利用しない」契約が最初から結ばれています。 さらに、産業保健業務に特化したテンプレートや、アクセス権限の厳格な分離(人事と産業医で閲覧できる情報を分ける等)が実装されていることが多く、実務の効率化と安全性を最も高い次元で両立できます。

まとめ:安全な環境構築で実現する、持続可能な産業保健

産業保健において、従業員の心身の健康状態という「究極のプライバシー」を取り扱う産業医や人事担当者には、極めて高い倫理観と情報管理能力が求められます。

生成AIは、面談記録の作成負担を減らし、従業員との対話やより本質的な職場環境改善に時間を使うための強力な武器になります。

「個人の設定任せ」から脱却し、ガイドラインや法令を遵守できるセキュアなAI環境を構築することこそが、従業員との信頼関係を守りながら、持続可能で質の高い産業保健活動を実現するための第一歩となるのです。

産業医の活用でお困りですか

医師ネットワーク 様々な業種・課題に対応できる産業医をご紹介します。

こだわり 実務経験や専門性を重視し、相性まで見極めてご提案。

相談までサポート 専任スタッフが伴走し、運用定着までしっかり支援します。

ご相談・ご提案はすべて無料です

最短即日でご提案いたします

産業医の役割理解から実務連携・面談フローの整備まで、サンポチャートの現役産業医チームが伴走します。